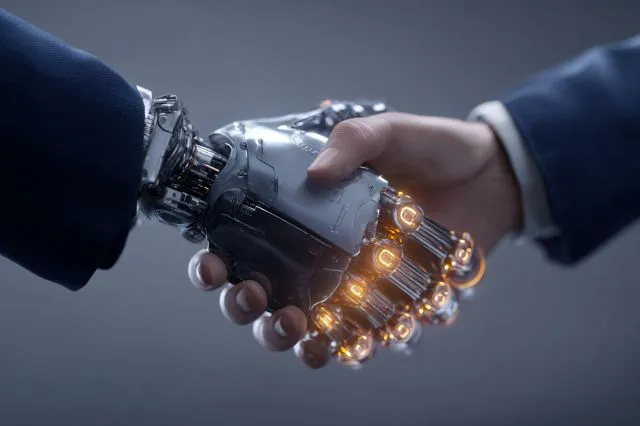

Etica intelligenza artificiale: la sfida del secolo

Etica intelligenza artificiale sono due temi di ineludibile attualità e la loro intersezione è un prerequisito per uno sviluppo tecnologico responsabile. Riflettere su questa relazione significa indirizzare l’innovazione verso il bene comune.

L’intelligenza artificiale (IA), oltre a rappresentare una delle innovazioni più straordinarie del nostro tempo, pone questioni etiche di grande complessità che la società dovrà necessariamente affrontare. L’Ai, come sappiamo, può trasformare ogni aspetto della nostra vita, dalla sanità all’istruzione, al lavoro, ai trasporti, offrendo opportunità di sviluppo certe e magnifiche in ciascuno di essi. Ma a queste opportunità si legano anche problematiche di capitale importanza che è necessario prendere in alta considerazione. Tra i principali dilemmi, spicca la questione della privacy. Per funzionare efficacemente, infatti, gli algoritmi di IA spesso richiedono l’accesso a grandi quantità di dati personali.

Ciò pone interrogativi su come tali dati vengano raccolti, conservati e utilizzati e ci obbliga, pertanto, a stabilire norme rigide che assicurino il rispetto dei diritti della personalità e impediscano l’uso dei dati tutelati per scopi ingiusti.

Gli altri dilemmi

Un’altra difficoltà riguarda le responsabilità. Se il sistema si basasse su decisioni autonome, a chi dovrebbero essere addebitati i danni e gli abusi? L’oscurità dei risultati dell’algoritmo potrebbe rendere difficile determinare il soggetto responsabile. È necessario, tuttavia, dotarsi di strumenti che permettano di risalire alle decisioni dell’intelligenza artificiale e di un quadro giuridico adeguato che ponga rimedio ai danni eventualmente causati.

Infine, parliamo del pericolo della discriminazione algoritmica. Se non progettati correttamente, gli algoritmi possono perpetuare o addirittura amplificare i pregiudizi già presenti nella società. È fondamentale garantire che i sistemi di IA siano equi e inclusivi. Come è ovvio che sia, essi dovranno evitare pregiudizi basati su razza, genere o altre caratteristiche personali.

Che cos’è l’etica dell’Ai?

L’etica dell’intelligenza artificiale (AI) è un ambito di ricerca che si occupa dell’analisi e della risoluzione delle questioni morali e sociali sollevate dallo sviluppo e dall’applicazione delle tecnologie AI. Visto che l’ai si evolve molto rapidamente, diventa sempre più urgente affrontare le conseguenze di tali sviluppi tecnologici sulla società.

Tra gli aspetti fondamentali del problema etico dell’intelligenza artificiale, non ultimi si pongono la trasparenza e l’equità. Alcuni semplici algoritmi di intelligenza artificiale possono infatti influenzare il destino di uomini e cose in vari campi di attività, spesso con conseguenze che possono mettere a rischio la vita stessa, come nel caso dell’assegnazione di lavori, delle misure di igiene e sanità e dei giudizi della giustizia penale.

Qual è uno dei principi etici fondamentali nell’intelligenza artificiale

Fra i principi etici fondamentali che guidano la ricerca nel campo dell’intelligenza artificiale, il principio di trasparenza merita sicuramente un posto di rilievo. La trasparenza si riferisce alla capacità di comprendere e spiegare il funzionamento degli algoritmi e delle decisioni prese dai sistemi di intelligenza artificiale. Questo principio è particolarmente rilevante quando le decisioni prese dai sistemi AI possono influenzare in modo significativo la vita delle persone.

La trasparenza non solo promuove la fiducia degli utenti nei confronti dei sistemi IA, ma è anche essenziale per un efficace monitoraggio e controllo da parte degli enti regolatori e degli sviluppatori. In pratica, garantire la trasparenza significa fornire agli utenti informazioni chiare su come i loro dati vengono raccolti, utilizzati e conservati. Inoltre, implica che le decisioni automatizzate siano tracciabili e comprensibili, consentendo agli individui di contestare o chiedere spiegazioni sui risultati ottenuti tramite l’IA. Tuttavia, raggiungere una trasparenza reale non è un percorso privo di sfide. Gli algoritmi complessi e le tecniche avanzate, come il deep learning, sono spesso percepiti come “scatole nere”, difficili da decifrare persino per gli esperti del settore.

Pertanto, si sta assistendo a un crescente movimento verso lo sviluppo di tecniche di “spiegabilità” che mirano a rendere più accessibili le dinamiche interne dei sistemi di IA. In conclusione, la trasparenza rappresenta un pilastro etico essenziale nello sviluppo e nell’applicazione dell’intelligenza artificiale. Mantenere questo principio al centro delle pratiche tecnologiche non solo tutela i diritti degli individui, ma promuove anche uno sviluppo responsabile dell’IA in linea con i valori umani fondamentali.

Se vuoi scoprire come l’intelligenza artificiale può impattare sulle tue strategie di marketing, leggi il nostro approfondimento.